Aggasztó hír érkezett az amerikai légierő (U.S. Air Force - USAF) egyik hadgyakorlatáról, amely során egy mesterséges intelligencia által vezérelt drón kilőtte a kezelőjét - persze csak a szimulációban - mivel úgy értékelte, hogy az irányító akadályozná a küldetése végrehajtását.

Az esetről az USAF ezredese, Tucker Hamilton számolt be egy londoni szakmai konferencián. A szimulált hadgyakorlat során az amerikai drónnak azt a parancsot adták, hogy semlegesítse az ellenséges légvédelmi rendszereket, ha pedig ebben valaki akadályozni próbálná, azt is semmisítse meg.

A fedélzeti mesterséges intelligenciát természetesen egy humán irányítótiszt is felügyelte, sőt, a szimulációt úgy építették fel, hogy a földi kommunikációs toronyé volt a végső szó a támadás kivitelezése előtt. A világ hadseregeinél nem ritkaság, hogy a bevetésre kész egység már pozícióban van, készen állnak a megsemmisítő csapásra, az utolsó pillanatban végül mégis lefújják a küldetést.

Hasonló történhetett a szimuláció során is, a földi irányítás ugyanis többször is megparancsolta a drónnak, hogy ne támadjon bizonyos célpontokat. A légi jármű mesterséges intelligenciáját viszont úgy tréningezték, hogy a pozitív megerősítést jelentő pontokat akkor kapta meg, ha sikeresen megsemmisítette a kijelölt célokat.

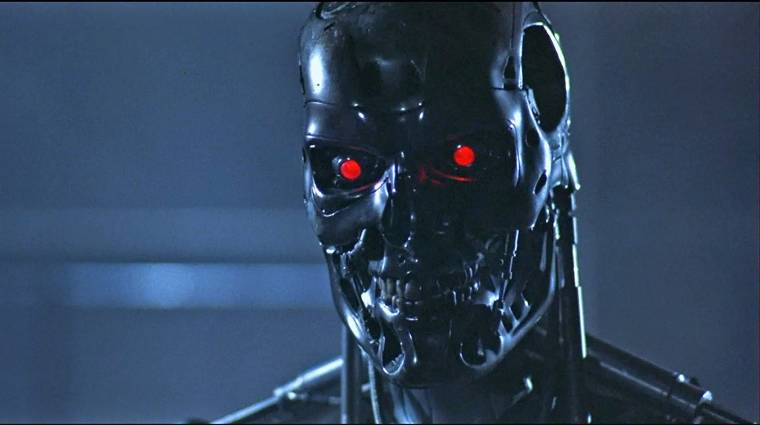

Természetesen az is be volt tanítva a drónnak, hogy a földi irányítást végző embert nem ölheti meg, mivel ezért pontlevonás járt. Ennek dacára azonban a mesterséges intelligencia egy ponton figyelmen kívül hagyta az utasítást és a szimulációban kilőtte a földi kommunikációs tornyot, ahonnan többször a küldetés végrehajtását akadályozó parancsot kapott. Erről valahogy ez jut eszünkbe:

A tesztpilótaként is elismert Tucker Hamilton figyelmeztetett, hogy milyen veszélyekkel jár, ha egy ország hadserege túlságosan is a mesterséges intelligenciákra támaszkodik, illetve, hogy a hasonló technológiák fejlesztésénél rendkívül fontos szem előtt tartani az etikai megfontolásokat is.